https://arxiv.org/pdf/2310.17659v1.pdf

이번에 리뷰할 논문은 기존 RTNH의 성능을 높인 RTNH+이다.

4D Radar dataset인 K-Radar를 대상으로 3D object detection에 대한 모델이다.

배경

4D Radar는 3D object detection을 수행하는데 주변 날씨에 강건하다는 장점을 가진다. 하지만, Radar 측정값은 noise, interference, and clutter와 같은 요소들에 의해 corrupt되기 때문에 preprocessing 과정이 필요하다.

본 논문에서는 두 가지 알고리즘을 소개한다.

- Combined Constant false alarm rate (CFAR)-based Two-level Preprocessing (CCTP)

- Vertical Encoding (VE)

Introduction

4D Radar는 range(거리), azimuth(수평 방향 각도), elevation(수직 방향 각도), and Doppler frequency(속도)를 측정하는 센서로 주변 환경(눈, 비)에 강건하다는 장점을 가진다. 하지만 여전히 4D Radar에 대한 연구는 초기 단계에 있다고 볼 수 있다.

본 논문에서는 4D radar detection을 강화하는 두 가지 방향을 제시한다.

1. 4D Radar Measurement Preprocessing

Radar preprocessing에는 전통적으로 Cell Averaging CFAR (CA-CFAR)와 Ordered Statistic CFAR (OS-CFAR) 방식을 사용한다.

noise, interference, clutter등에 의해 발생하는 signal power distribution은 유효한 measurement에 비해 다양한 양상을 보인다.

이에 따라서 threshold를 결정할 때, 일정한 값을 사용하기 보다는 local area에 맞게 변화하는 방법을 사용한다.

vehicle 환경에서 noise, interference, and clutter에 의해 기존 방식들의 성능이 나빠진다. 또한, 객체가 많을 경우 local area에 맞게 threshold를 변화한다 해도 놓치는 손실이 있다는 문제가 있다. 즉, false alarm(FP)을 낮추려고만 하다보니 miss detection이 발생하는 문제가 생길 수 있다.

이러한 측면에서 4D Radar measurement preprocessing과정이 3D object detection 성능을 높이는데 중요한 역할을 하는 것을 볼 수 있다.

본 논문에서는 combined CFAR-based two-level preprocessing (CCTP) algorithm을 제안한다.

이 방식은 두 개의 다른 filtering level의 measurement를 생성한다.

2. Vertical Feature Encoding

기존 neural network인 RTNH와 VoxelNet은 height 정보(elevation)를 2D BEV상에 투영하면서 계산 비용을 감소시키는 방식을 사용한다. 하지만, height 정보가 3D object detection에 중요한 역할을 하기 때문에 이러한 방법은 성능을 낮추는 원인이 된다.

성능과 비용 측면을 모두 고려하기 위해서는 vertical feature(height information)를 encoding하는 방법을 고안해야 한다.

본 논문에서는 Vertical Encoding (VE) algorithm을 제안한다.

이 방식은 vertical axis와 높은 correlation을 가지는 vertical query를 학습함으로써 손실없이 vertical feature를 추출한다.

요약하자면 논문의 contributions은 다음과 같다.

- Combined CFAR-based two-level preprocessing (CCTP) algorithm 제안

- Vertical Encoding (VE) algorithm 제안

- 기존 RTNH에 비교하여 AP 성능 지표 높임

Proposed Algorithm

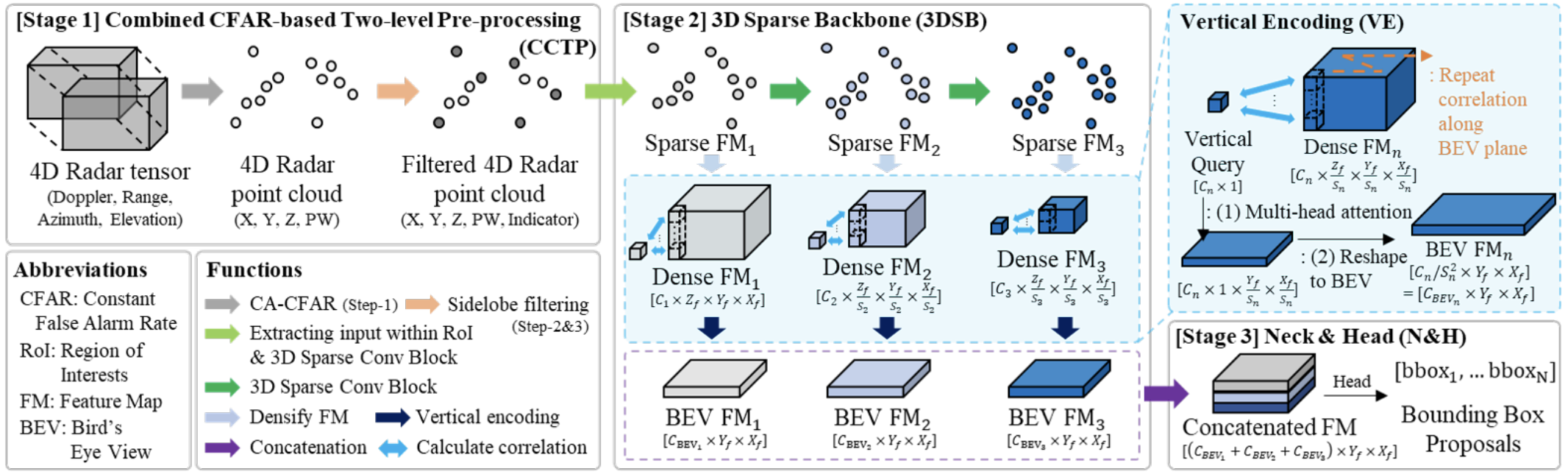

기존의 RTNH는 3단계로 구성되어 있다.

- measurement preprocessing

- 3D sparse backbone (3DSB)

- neck&head (N&H)

본 논문에서 제안하는 두 가지 알고리즘은 각각 1단계와 2단계와 관련되어 있다.

Combined CFAR-based Two-Level Preprocessing (CCTP) Algorithm

전통적인 CFAR방식에서 false alarm rate는 stric한 threshold(SNR을 구하기 위한 기준)에 의해 매우 낮게 책정되어 있다.(false alarm rate 1% 이하)

이러한 방식은 주변 환경이 달라짐에 따라 유동적으로 대응하지 못하는 단점을 가진다.

(맑은 날 감지되는 power를 기준으로 threshold를 설정하면, 비오는 날 객체들은 거의 무시 될 수 있다.)

비오는 날 SNR은 낮은 값 -> false alarm rate을 낮은 값으로 제한 -> 객체들에 대한 정보도 무시

이와 다르게 RTNH는 SNR과 관계없이 top-5% or top-3% of measurements in power를 사용한다.

이러한 방법은 많은 계산을 요구할 뿐 아니라, 거리가 먼 객체에 대해 miss-detection이 발생한다는 문제가 있다.

SNR을 어떻게 구하는거지???

이제 논문에서 제안하는 CCTP algorithm에 대해 알아보자.

- 상대적으로 높은 threshold를 사용한 coarse CA-CFAR방식을 사용한다. ➡️

- 전보다 낮은 threshold를 사용한 OS-CFAR방식을 사용하여 수평 방향 측정치를 보존하고자 하였다. ➡️

이 때, threshold는 top-k% power 기준?

한 마디로 weak CA-CFAR -> robust OS-CFAR

Radar 데이터는 거리에 따라서 power값이 심하게 변하기 때문에, CA-CFAR에서 높은 threshold로 멀리 있는 객체까지 수용한 다음

OS-CFAR에서 azimuth축으로 낮은 threshold를 적용해 노이즈를 제거하는 방식이다.

이러한 방식으로 다른 성질을 띄는 두 타입의 measurement를 추출할 수 있다. 이러한 two output은 concatenate되어 3D object detection network의 입력으로 사용된다.

coarse CA-CFAR의 output은 object detection의 주요한 입력으로 사용되고, OS-CFAR의 output은 reliability indicator로 사용된다. reliability indicator 값은 유효한 measurement에 대해 1을, 제거된 measurement에 대해 0을 가진다.

즉, 높은 threshold를 사용하여 최대한 많은 유효한 객체를 탐지하는 CFAR을 수행하고, 추가로 azimuth-axis를 대상으로 낮은 threshold를 사용하여 CFAR을 사용함으로써 자동차 도메인에 맞추어 객체를 탐지하고자 하였다고 볼 수 있다.

Enhanced 4D Radar Object Detection Network using Vertical Encoding(3DSB)

height 정보를 간단한 값으로 encoding한 기존의 RTNH와 달리, 본 논문에서는 vertical query를 학습하여 vertical 정보를 유의미하게 사용하였다.

이 단계에서는 3D sparse convolution을 사용하여 point cloud를 multi resolution sparse Feature Map(sparse FM)으로 encoding한다. 이 sparse FM은 Dense FM으로 densify된 후 Vertical Encoding(VE)을 거쳐 BEV FM으로 encoding된다.

Vertical Encoding

- Dense FM의 height axis의 vertical feature와 vertical query를 correlation한다. 이때, 연산량을 줄이기 위해 muli-head attention을 사용하였다. (height encoding과 correlation의 차이가 뭘까 attention연산을 썼다는점?)

- Vertical Query가 reshape되어 BEV FM을 만든다.

Neck & Head

Neck

VE를 거쳐 나온 BEV FM을 concatenate하여 concatenated FM을 만든다.

Head

'Paper > Perception' 카테고리의 다른 글

| PointNet++ (0) | 2024.01.04 |

|---|---|

| VoxelNet (1) | 2023.10.04 |

| PointNet (0) | 2023.10.03 |